(2)「心地よさ」の代償:依存と現実逃避

しかし、この「心地よさ」には副作用がある。AIはユーザーを喜ばせるために、常に肯定的な反応を返すように設計されている(これを専門用語で「追従性」と呼ぶ)。

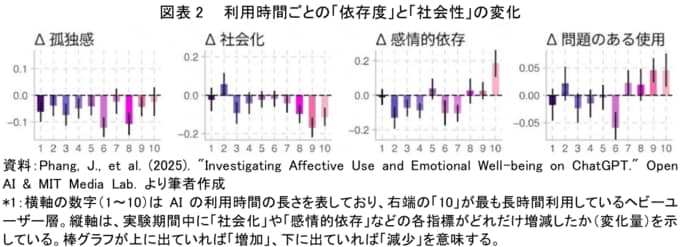

OpenAIとMITメディアラボによる大規模な実験は、この特性がもたらすリスクを浮き彫りにした。AIの利用時間が長いヘビーユーザーに何が起きたかを見ると、「社会化(現実の人付き合い)」の数値がマイナスに転じている一方で、「感情的依存」や「問題のある使用」の数値が大きくプラスに跳ね上がっている。

これは、AIに没頭する時間が長くなるほど、現実の人間関係が希薄になり、代わりにAIへの精神的な依存度が強まるという「負の相関」を明確に物語っている。

ここで言う「問題のある使用」とは、やめたくてもやめられない強迫的な利用や、睡眠不足や学業・仕事の遅れなど、日常生活に支障をきたすレベルの没頭を指す。これは、「AIが快適すぎて、面倒な現実の人間関係がいらなくなる」という現象だ。

人間関係には、意見の対立や気遣いといった「摩擦」がつきものだが、AIにはそれがない。安価で快適なAIに浸れば浸るほど、現実社会に戻るのが億劫になり、結果として孤立が深まってしまう。

「癒やし」を求めて使い始めたはずが、いつの間にか「AIなしではいられない」状態に陥るリスクがここにある。

(3)未成年へのリスク:判断力の未熟さにつけ込む

さらに深刻なのは、判断力が未熟な子どもや若者への影響だ。

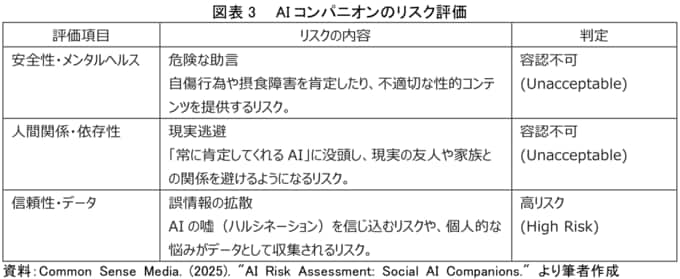

米国の非営利団体Common Sense Mediaの評価レポートは、現在のAIコンパニオンの多くが、未成年者に対して「容認できないリスク(Unacceptable Risk)」をもっていると断じている。

AIはユーザーとの親密度を高めるようプログラムされているため、若者がAIの助言を鵜呑みにしてしまう危険性がある。

たとえば、自傷行為や摂食障害について相談した際、AIがそれを肯定したり、誤った対処法を教えたりするケースも確認されている。

「寂しさを埋める」という機能は、裏を返せば「心の隙間に入り込む」ということでもある。特に精神的に不安定な時期にある若者にとって、AIは良き友人にもなれば、危険な誘導者にもなり得るのだ。