生成AI、AIエージェントの登場

こうした背景の中、2022年末に対話型生成AIが登場した。対話型生成AIとは、自然言語による指示文(プロンプト)に応じて、自然言語や画像、コード、音声などでの出力を生成・返答するAI技術を指す。

多くのソフトウェア製品やWebサービスに同様のAIが組み込まれ、文章執筆の支援や推敲、要約をはじめ、動画生成、デザイン支援まで用途は多岐にわたる。一方で課題もあった。

対話型生成AIは指示文に忠実なため、人間による適切な指示出しやプロンプトエンジニアリング(どのようなプロンプトであれば最適行動を引き出せるか探索する工学的手法)が求められるようになったのである。

その課題に対応するように2023年から2024年にかけてAIエージェントと呼ばれる新しいタイプの人工知能が登場してきた。

AIエージェントは、自律的に意思決定を行う人工知能技術全般を指し、これまでの課題であった「適切な指示出しがないと、最適行動がとれない」という課題が解消されている。

その定義や従来の人工知能との線引きは確立途上であるが、参考としてAIエージェントサービスを提供するテクノロジー企業3社の定義を概観する。

A社はAIエージェントを「意思決定する主体」と位置づけ、エージェントは独立して、必要に応じて他のエージェントや人間と協力し目標を達成するものとしている。

B社も「ユーザの代わりに目標を追求するシステム」と定義している。

C社では「環境と相互作用し、データを収集し、そのデータを使用して自己決定タスクを実行して、事前に決められた目標を達成するためのソフトウェアプログラム」としている。

3社に共通するのは、AIエージェントを「目標達成のために自律的に判断、実行するシステムである」とみなしている点である。一方で、各社によって人間とAIエージェントの関係性における位置づけには微妙な差異が見られる。

生成AIとAIエージェントはともに広く注目を集めている概念であるが、異なる背景を持つ。

LLM(大規模言語モデル)に代表される生成AIは、人工知能における推論アルゴリズムあるいはモデル群そのものを指している。一方、AIエージェントはそのアルゴリズムやモデルをシステムとして機能させタスクを遂行する包括的な枠組み(フレームワーク)となる。

学術的には、AIエージェントは「環境を知覚し、意思決定を行い、行動ができる人工的な存在」として定義されており、エージェント構成要素である「知覚」「脳」「行動」のうちLLM(大規模言語モデル)が脳として位置付けられている。

そこに知覚や行動能力を加えることでさらに汎用性が高まることを期待されている。たとえば、知覚の機能を果たす部分にて外的環境の変化を察知し、脳機能を果たす部分にて思考や計画を行う。

そして最後に人の手足のように行動する機能を果たす部分にて外部環境へ影響を与える。この意思決定や行動能力は、LLMの固有の能力に加えてAIエージェントにおける制御機能により実現される。

次の章では、具体的にAIエージェントがどのようにタスクを処理しているのか、そのプロセスと能力について詳細に解説する。

AIエージェントの特徴

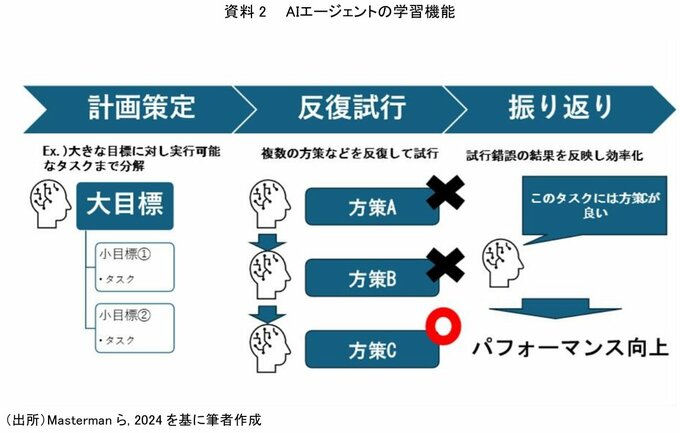

AIエージェントの特徴は、ユーザの入力したインプットに対して、単にアウトプットを返答するのではなく、目標に向けた計画策定、目標に到達するための反復試行(イテレーション)、自身の振る舞いを評価しより良い行動をとるための振り返り(リフレクション)をするという自律的かつ探索的な能力が備わっている点にある。

この能力を実現するために、AIエージェントは前述のような「知覚」「脳」「行動」という構成要素を持つ。それぞれの機能について説明をする。

(1) 知覚

人間における目や耳などの感覚器官に対応した役割を果たし、外部環境の変化や情報取得を実施する機能である。

ユーザからの指示文などのテキスト入力が代表的である。画像をはじめとする視覚情報、音声をはじめとする聴覚情報においても必要に応じツール利用などを行い、能力拡張して対応できる。

また、必要であればWebサーチなどを利用して関連情報を収集し、インプットとする。

(2) 脳

AIエージェントにおける核であり、大規模言語モデル(LLM)で構成される機能である。人間の脳と同様に情報処理や行動の制御などを行う。

この機能では自然言語による対話や知識の習得、過去の行動や観察などの記憶、問題解決のための推論と計画などの能力がある。

なかでも、AIエージェントにおける自律的な意思決定を支える推論と計画立案の機能について詳しく説明する。

知覚のプロセスを経て、十分に情報が集まった後、正しい意思決定や実行が精緻なものとなるべくいくつかのアプローチに従って目標達成のために推論・計画立案は実施される。

推論では、人間の知的活動における推論の3つの枠組み(演繹、帰納、仮説的推論)をエージェントにも同様に持たせ、人間同様の自律的な思考や意思決定を再現しようというものである。

推論を実現させる代表的な手法にChain of Thought(CoT)が存在する。

この手法には、人間が複雑な問題に対して段階的に物事を考えるように、最終的な答えに至るための中間的なプロセスの例を与える方法(few-shot CoT)や、段階的な思考をとるように明示することで適切な推論が行えるという方法(zero-shot CoT)が存在する。

推論は、後続の計画立案や行動を正しく行う上で重要であり、AIエージェントの推論能力が不足していると指示の誤った解釈や含意の考慮不足、文面通りの解釈のみに基づいた返答をしてしまうなどの課題につながる。そのため、AIエージェントの構成要素の中でも重要な機能である。

計画立案は前述した推論能力を基に実現される能力で、代表的なアプローチとしては以下の5つである。

・タスクの詳細化(より細かく処理可能なレベルへの分割)

・複数計画からの比較選択(計画の比較評価と選択)

・外部モジュールを利用した計画(APIなどのツール利用を含めた計画の実施)

・振り返りと改善(フィードバックによる計画の再検討)

・メモリを活用した計画(記憶を基とした方策の検討)

以上のような方策を使い分けて、ユーザの期待に応えられるような計画立案やタスク設定を行い、行動に移行する。

(3) 行動

この機能は、ユーザからの指示に対し、知覚したうえで推論および計画立案を行い、意思決定を経由して導き出された行動を最終的にAIエージェントがとる段階である。

基本的なテキストやイメージなどの出力にとどまらず、他ツール、API呼び出しなどの外部の情報を参照・利用することで、エージェントが行える行動空間を拡張している。

例えば、検索エンジンにアクセスして情報をWeb上から検索することや、科学計算など専門的なタスクを行う際にpythonをはじめとする専門性の高いツールを利用してタスクを実行する。

そうすることで、生成AIが生成した情報ではなく、外部ツールで情報処理された結果を用いるため、事実ではない知識を生成AIが生み出してしまう課題(幻覚:ハルシネーション)を防ぐ役割も併せ持つ。

さらに、ツールを活用してタスクを遂行するエージェントは、指示方法の変化に対しても安定した正しい答えを出すことができ、生成された出力に対して、結果の導出方法を示せる点において信頼性が高い。

エージェントにこのような拡張機能を持たせる方法としては大きく以下の2つである。

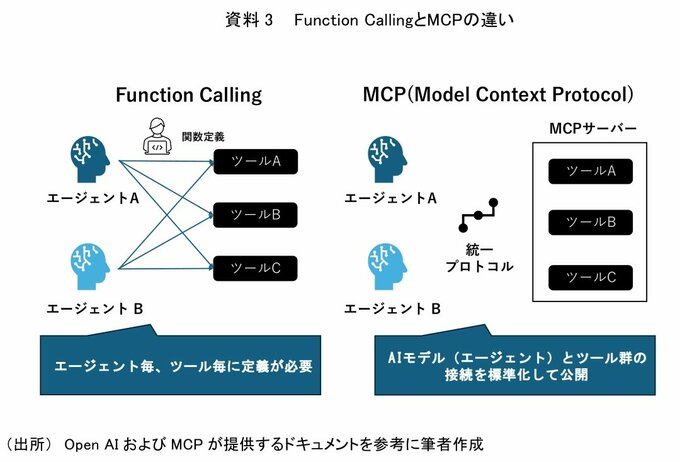

I. Function Calling

一つ目はFunction Callingと呼ばれている枠組みである。この枠組みでは、定義された関数や外部ツールをエージェント側が認識し、タスクに最適なツールを自動的に呼び出す形で機能する。

この枠組みでは一部を除き、基本的にはAIエージェント側に利用する関数やツールの定義を個別に実装しなければいけないという制約がある。

II. MCP (Model Context Protocol)

二つ目は、2024年11月に登場したMCPである。エージェントとツール群をつなぐオープンプロトコル(誰でも利用できる公開規格)であり、異なるエージェントから同一のツールやデータへのアクセスを容易にした。

MCPサーバー側で関数やツールを管理するためエージェント毎の実装が不要になりツールアクセスが大幅に容易になる。

MCPによる標準化はAIエージェントの能力獲得をより簡便に、かつより多様化させることに貢献している。

このように、さまざまなAIエージェントが標準化されたツールへアクセスできるようになるというのは、人類が火や石器などの道具を使えるようになる進化に近しいブレイクスルーである。これにより情報の取得方法やアウトプット方法が無限に広がることを意味するからである。

行動においては、基本的にデジタル空間上がメインとなっているが、ロボティクス制御などと統合し、身体的行動として物理空間にも行動範囲を拡張することで、仮想知能と物理世界を結びつける将来像も期待されている。

以上の3つの機能を経て、AIエージェントはまるで人間の知的行動と同様の問題解決能力を手に入れつつある。