老若男女騙されやすく、家族・友人との会話でさらに拡散

私はGoogle JapanとInnovation Nipponという実証研究プロジェクトを推進しており、近年はこのフェイク情報問題をテーマの1つとしている。2024年に発表した最新の研究成果を紹介しよう。

研究に当たっては国内で2022年から2023年にかけて実際に拡散したフェイク情報15件について、人々の真偽判断行動や拡散行動を調査した。調査は2万人を対象にスクリーニングした上で、いずれか1つ以上のフェイク情報を見聞きした人3700名の回答を分析した。

真偽判断行動について分析した結果、フェイク情報を見聞きした人の中でその誤りを認識していた人は加重平均でたった14.5%に過ぎなかった。51.5%は正しいと思うと信じており、残りはわからないと判断を保留していた。

しかも年齢別に見ても特に傾向は見られず、若い世代も中高年以上も同程度に騙されていた。このデータが示すのは、フェイク情報はSNSを多く利用する若者だけの問題ではなく、老若男女問わず大多数の人々がフェイク情報に騙され、その真偽を見極めるのが困難であるという状況である。

さらに、拡散行動の調査でも興味深い結果が出た。フェイク情報を見聞きした人のうち、平均して17.3%が何らかの方法で拡散していたが、その拡散手段として最も多かったのは家族・友人知人との直接の会話だったのである。約半数が直接の会話で拡散していた。

つまり、SNSやネットニュースのコメント欄で聞いた情報を家族に話し、それがまたSNSに投稿されるといった、インターネットとリアルが連関する現象が起こっているのである。フェイク情報は情報空間全体の問題として考える必要がある。

生成AI時代の選挙とフェイク情報

AI技術の発展、そして生成AIの普及はディープフェイクの大衆化という現象をもたらしている。つまり、誰もが手軽にディープフェイクによって偽動画や偽画像を作成することが可能になった。

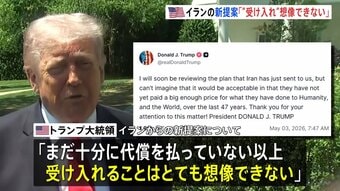

これは将来におけるフェイク情報の爆発的な増加を意味しており、私はこれを「Withフェイク2.0時代」という新たな局面に突入したと呼んでいる。この現象はすでに現れている。災害時の混乱を増幅させる投稿、政治的意図で発信された偽動画、ディープフェイクによる詐欺行為など、悪用例が増加している。

この大衆化という現象は、同時に世論工作の大衆化という現象ももたらしている。安価に、そして簡単に利用できる技術を活用して、個人やグループが社会や政治に影響を与える力を増大させているのである。

ある組織が、大量のアバターを作成してそれらにSNSアカウントを付与し、AIを使ってSNS投稿を自動生成・投稿して世論工作を展開するというビジネスを行っているという報道もあった。この手法はすでにいくつかの国の選挙で利用され、日本語での操作も確認されているようだ。