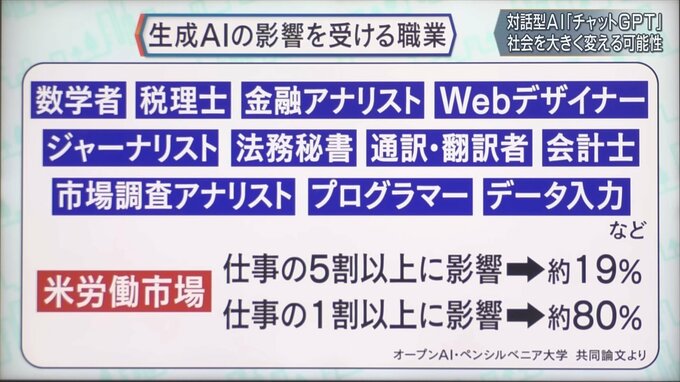

米労働市場「仕事の1割以上に影響が出る人」が80%。政府レベルでのAI倫理の議論が必要

チャットGPTを開発したオープンAIとペンシルベニア大学によると、チャットGPTなどの生成AIの影響を受ける職業としてさまざまな職種が挙げられている。アメリカの労働市場で見ると、仕事の5割以上に影響が出る人が約19%、1割以上に影響が出る人が80%となっている。

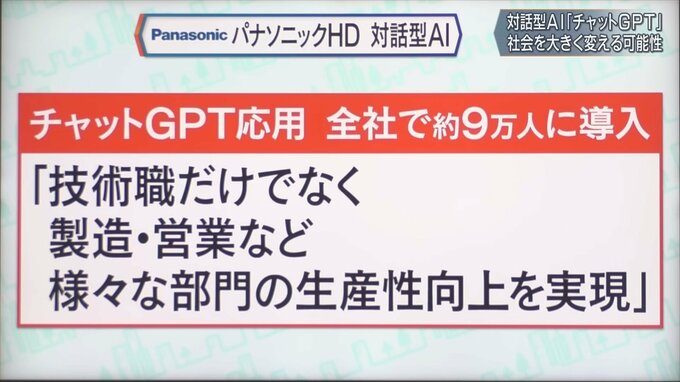

日本でもいろいろな企業が、もうすでに導入を考えており、パナソニックの場合、技術職だけではなく、営業などの人たちの生産性向上にも期待しているとしている。

――どのような形で業務に使われていくのか。

早稲田大学ビジネススクール教授 入山章栄氏:

一番わかりやすいのはホワイトカラーの仕事です。ほとんどが、先ほど言ったインテリジェンスで、社内外の情報を集めて整理してパワーポイントや文章にする仕事です。(チャットGPTは)ほぼ全部やってくれるわけです。ホワイトカラーの仕事は9割ぐらいなくなるという方もいます。ただ、私は序の口だと思っています。プログラミング言語も言語の一種で、チャットGPTはこれを簡単に書いてくれ、さまざまなプログラミング、デジタル周りのものが、全部置き換えられる可能性が出てきます。マルチモーダルと言いますが、文書だけではなく動画や画像なども簡単に生成してくれるようになるのです。

――一人一人がやっている縦展開が簡便になるだけではなく、他部署の人に頼んだりしている横展開も一緒にやってくれるようになるのか。

早稲田大学ビジネススクール教授 入山章栄氏:

やってくれるようになります。そして、これが重要なのですが、APIと言ってプログラミングの共通言語情報のようなものを公開しているのです。世界中のあらゆるデジタル系の会社が、自分の会社のアプリケーションをチャットGPTとつなげられるのです。これをプラグインと言って、我々が普段スマホやパソコンで使っているアプリケーションにチャットGPTを入れられるのです。さまざまなアプリケーションがチャットGPTを介して連動して、プログラミングを書くということを勝手にやるということが起き得るということです。

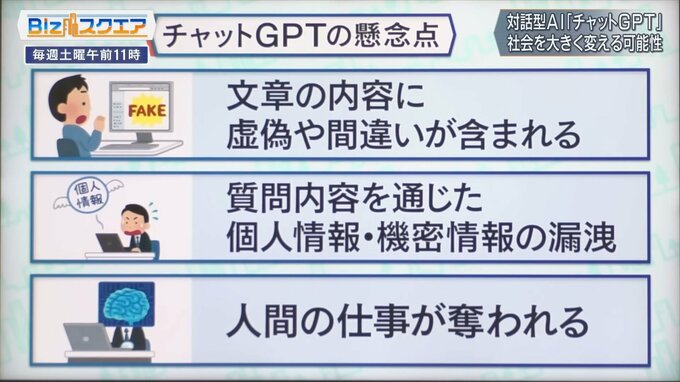

懸念材料がいろいろ出ている。「間違いがあったらどうするのか」、「個人情報、機密情報が漏洩しないか」、「今の仕事が奪われる」などいろいろある。

――インターネットが出てきた時もこういう不安はたくさんあって、今もルール作りが並行して行われている。今後のルール作りの重要性はどこにあるのか。

早稲田大学ビジネススクール教授 入山章栄氏:

生成系AIの流れそのものを止めることはおそらく不可能です。ポイントは我々が健全に規制をするということが重要で、チャットGPTも強化学習と言うのですが、最後は人間の価値観で判断させているのです。意外とチャットGPTは倫理的です。例えば人種差別のような発言を入れると、「それは人種差別だから私は答えられません」というようなことをちゃんと言う。その倫理観はどうやって持たせているかというと、人間がちゃんとこれはダメだよと教え込んでいるのです。ということは、チャットGPTはまだ比較的倫理的なのですが、そうではない生成系AIを作ってくる人が違う価値観、例えば「もっと戦争はしていい」とか「人を殺めてもいい」というような倫理観を植え込むことも不可能ではないわけです。こういったAIが暴走する可能性がいよいよ出てきたので、政府レベルで徹底してここの規制を議論する必要は出てきていると思います。

(BS-TBS『Bizスクエア』 4月15日放送より)